MiniGPT-4--在线使用/本地部署--与图片对话

MiniGPT-4是什么?

GPT-4 已经发布一个多月了,但识图功能还是体验不了。

来自阿卜杜拉国王科技大学的研究者推出了类似产品 —— MiniGPT-4,大家可以上手体验了。

它能提供类似 GPT-4 的图像理解与对话能力,让你先人一步感受到图像对话的强大之处。

MiniGPT-4可以做什么?

它可以做的一些事情:

解释照片上的内容

发现问题并解决它们(例如:枯死的植物,如何处理)

为照片写诗

给你一个草图的 HTML/JS 代码(我实际上试过了,但它并没有真正起作用..)

为给定的照片写广告

为给定的膳食照片写食谱和购物清单

解释艺术

官网:https://minigpt-4.github.io/

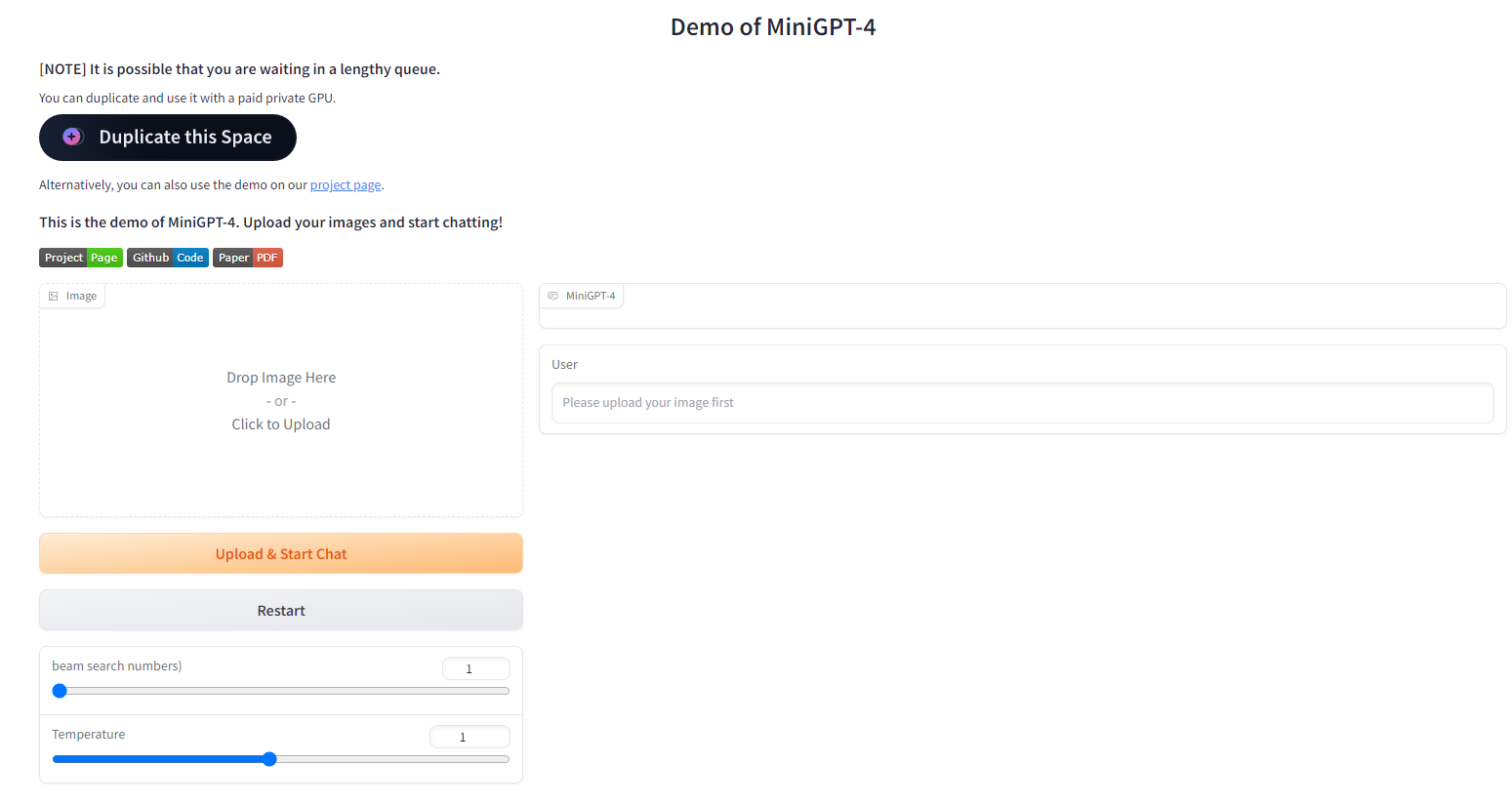

体验地址:https://huggingface.co/spaces/Vision-CAIR/minigpt4

视频演示

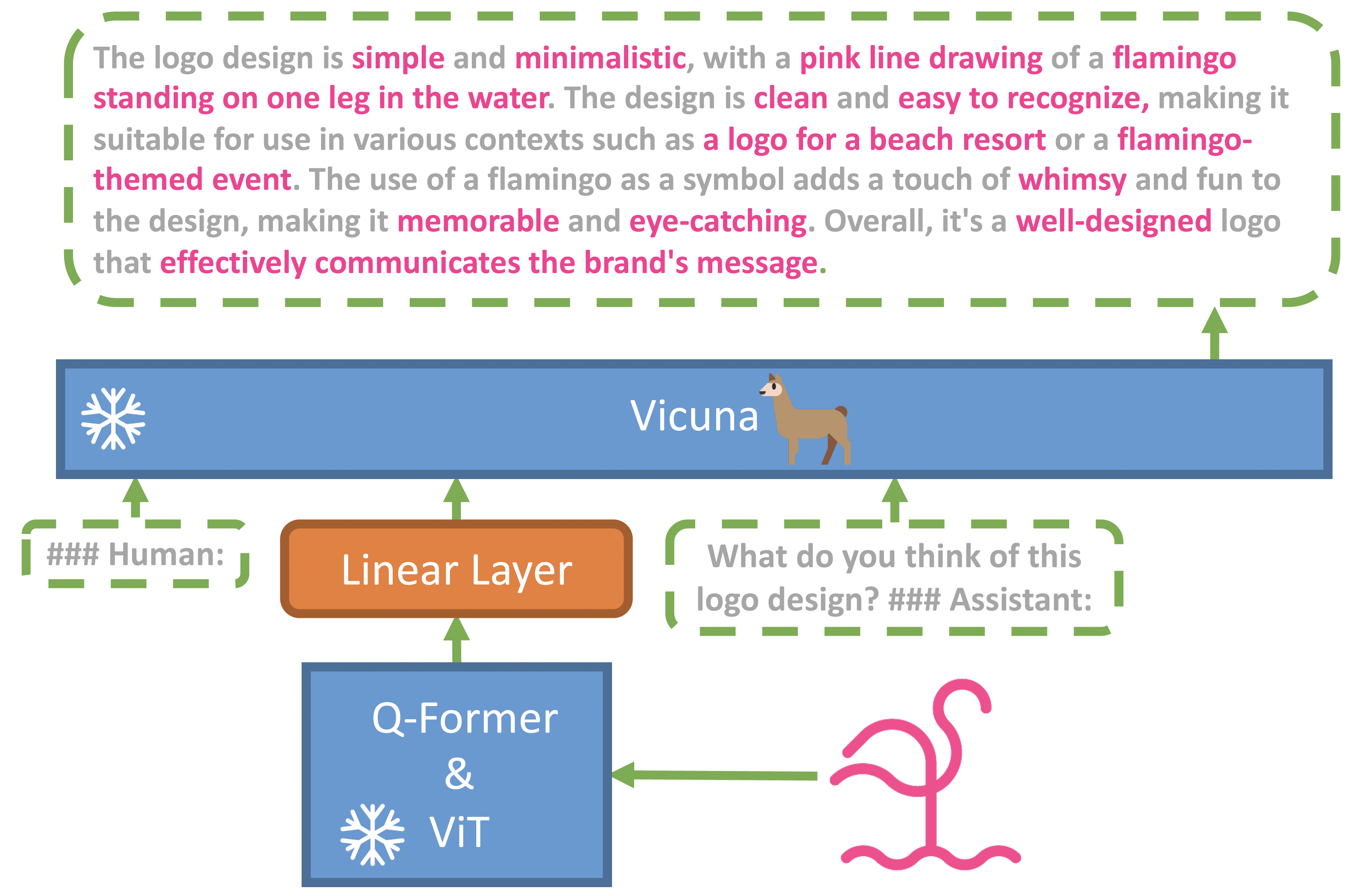

通过先进的大语言模型增强视觉语言理解

最近的 GPT-4 展示了非凡的多模态能力,如直接从手写文本生成网站和识别图像中的幽默元素。这些特性在之前的视觉语言模型中很少被观察到。我们认为,GPT-4 先进多模态生成能力的首要原因是利用了更先进的大型语言模型(LLM)。为了检验这一现象,我们提出了 MiniGPT-4,它通过仅使用一个投影层将冻结的视觉编码器与冻结的 LLM Vicuna 对齐。我们的发现表明,MiniGPT-4 具有类似于 GPT-4 展示的许多能力,如详细图像描述生成和从手写草稿创建网站。此外,我们还观察到 MiniGPT-4 中的其他新兴能力,包括根据给定的图像创作故事和诗歌、为图像中显示的问题提供解决方案、根据食物照片教用户如何烹饪等。在我们的实验中,我们发现仅在原始图像-文本对上进行预训练就可能导致不自然的语言输出,包括重复和句子片段化。为了解决这个问题,我们在第二阶段策划了一个高质量、对齐良好的数据集,以便使用对话模板微调我们的模型。这一步骤对于增强模型生成的可靠性和整体可用性至关重要。值得一提的是,我们的模型具有很高的计算效率,因为我们只训练了一个投影层,使用了大约 500 万个对齐的图像-文本对。